بيان صادر عن المنظمة الدولية لحقوق الإنسان وشؤون اللاجئين

تحذير وتوصية بشأن الاستخدام غير المنظَّم للتقنيات الذكية في تتبّع المجتمعات المهمّشة

الشرق الأوسط وشمال إفريقيا – 7 حزيران 2025

مع التوسع المتسارع في استخدام تقنيات الذكاء الاصطناعي، خصوصًا أنظمة التعرّف على الوجه وتحليل البيانات، بدأت تظهر تحديات جديدة تتعلق باستخدام هذه الأدوات في مناطق النزاع والمخيمات ومراكز اللجوء، ما يثير مخاوف جدّية حول حماية خصوصية وحقوق الأفراد.

وقد رصدت المنظمة الدولية لحقوق الإنسان وشؤون اللاجئين بوادر توجّه عالمي لاستخدام هذه التقنيات في تتبع تحركات المجتمعات المهمّشة، ما قد يؤدي إلى تقييد وصولها إلى الحماية أو الخدمات الأساسية، في حال غابت الضوابط القانونية والمعايير الأخلاقية.

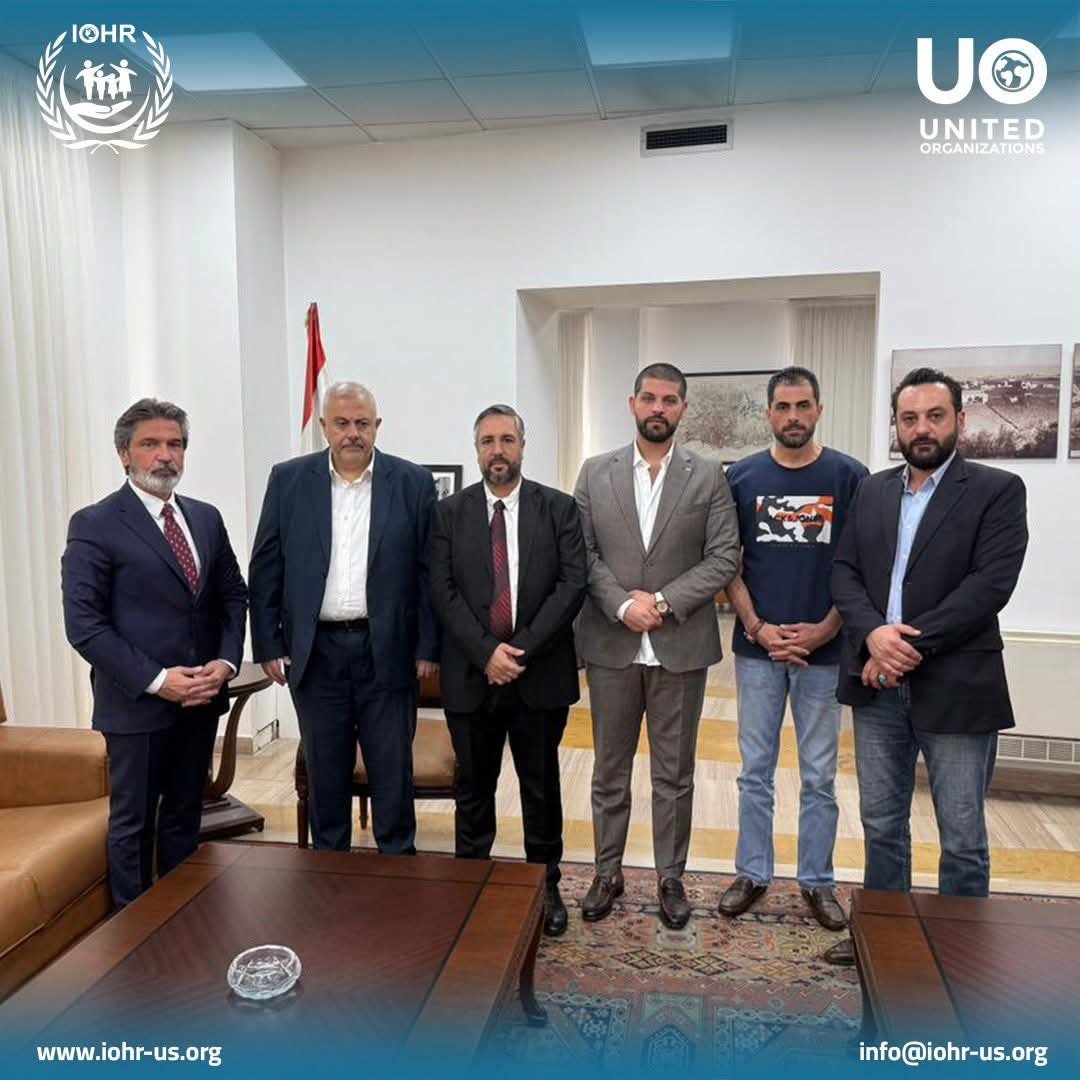

وفي هذا السياق، يشير #عماد_ركبي_مدير_العلاقات_العامة

لمنطقة الشرق الأوسط وشمال إفريقيا لدى المنظمة، إلى أن “التقنيات الذكية قادرة على دعم الجهود الإنسانية بشكل غير مسبوق، لكن دون وجود آليات حماية، قد تصبح عامل ضغط بدل أن تكون أداة دعم”، ويؤكد أن “المنظمة تعمل جاهدًة على أن تكون جهة رئيسية في الربط والتنسيق مع الجهات الدولية والشركات العاملة في مجال الذكاء الاصطناعي، بما يضمن توظيف هذه الأدوات لخدمة الإنسان أولًا، وحمايته قبل أي اعتبار تقني أو تشغيلي”.

التوصيات:

1. تعزيز الشفافية والمعايير الأخلاقية في استخدام أدوات الذكاء الاصطناعي داخل البيئات الإنسانية.

2. توقيع مذكرات تفاهم مع الشركات المطوّرة للذكاء الاصطناعي لضمان التزامها بحقوق الإنسان في تصميم واستخدام هذه الأدوات.

3. دعم وتمويل المشاريع التقنية التي تُعنى بدمج الذكاء الاصطناعي بشكل مسؤول لخدمة اللاجئين والمجتمعات الهشّة.

4. إشراك منظمات المجتمع المدني والجهات الأكاديمية في صياغة سياسات تكنولوجية عادلة، تركّز على الحماية والمساءلة.

خاتمة:

تدعو المنظمة الدولية لحقوق الإنسان وشؤون اللاجئين إلى تحرّك جماعي ومسؤول من كافة الأطراف المعنيّة لوضع أسس واضحة ومُنصفة لاستخدام الذكاء الاصطناعي في العمل الإنساني.

فالمستقبل التقني لا يمكن أن يكون إنسانيًا ما لم نضع الإنسان في مركزه.